Jennifer in paradiso

C’è una fotografia di una donna di spalle, seduta in riva al mare cristallino di Bora Bora, mentre guarda verso l’orizzonte.

Ciao,

ben ritrovate e ben ritrovati su Ellissi, la newsletter cui ogni tanto piace prendersela comoda. Siete più di 17.000!

A supportare la puntata di oggi dagli amici di The Visual Agency, che con il loro progetto Nimbo raccontano lo stato della qualità dell’aria sui social.

Oggi partiamo da una vecchia fotografia, e parliamo di come - a volte - la storia si ripeta.

Buona lettura,

Valerio

Jennifer in paradiso

C’è una fotografia di una donna di spalle, seduta in riva al mare cristallino di Bora Bora, mentre guarda verso l’orizzonte.

La testa è leggermente inclinata verso sinistra, il vento le arriccia i capelli sul volto, c’è un atollo sullo sfondo.

Questa è la storia di “Jennifer in paradise” — una fotografia che, a suo modo, ha cambiato la storia.

Non si tratta di uno scatto particolarmente originale, né è in sé un documento di particolare rilevanza: è semplicemente una foto scattata da una coppia in vacanza.

Ma quell’immagine, che risale al 1987, è stata una delle prime fotografie modificate digitalmente — l’immagine-cavia che ha dato vita a uno dei software di photo editing per eccellenza, Photoshop.

La storia di quella foto e del suo destino, tanto tortuosa quanto interessante, fu raccontata anni fa proprio da chi la scattò: John Knoll, l’allora fidanzato della donna, che del popolare software di Adobe sarebbe poi stato uno degli inventori.

Quando il Guardian, ormai dieci anni fa, gli chiese cosa pensasse del mondo fotoritoccato “creato” dalla sua invenzione, Knoll rispose così: «Ogni strumento può essere usato per fini buoni o cattivi. Tutto sta nell’etica dell’artista che lo utilizza».

Harari Swift

Il tema dell’eticità del fotoritocco e del videoritocco, per usare due termini ormai forse vetusti, è ancora più centrale oggi, con il diffondersi degli strumenti di intelligenza artificiale generativa.

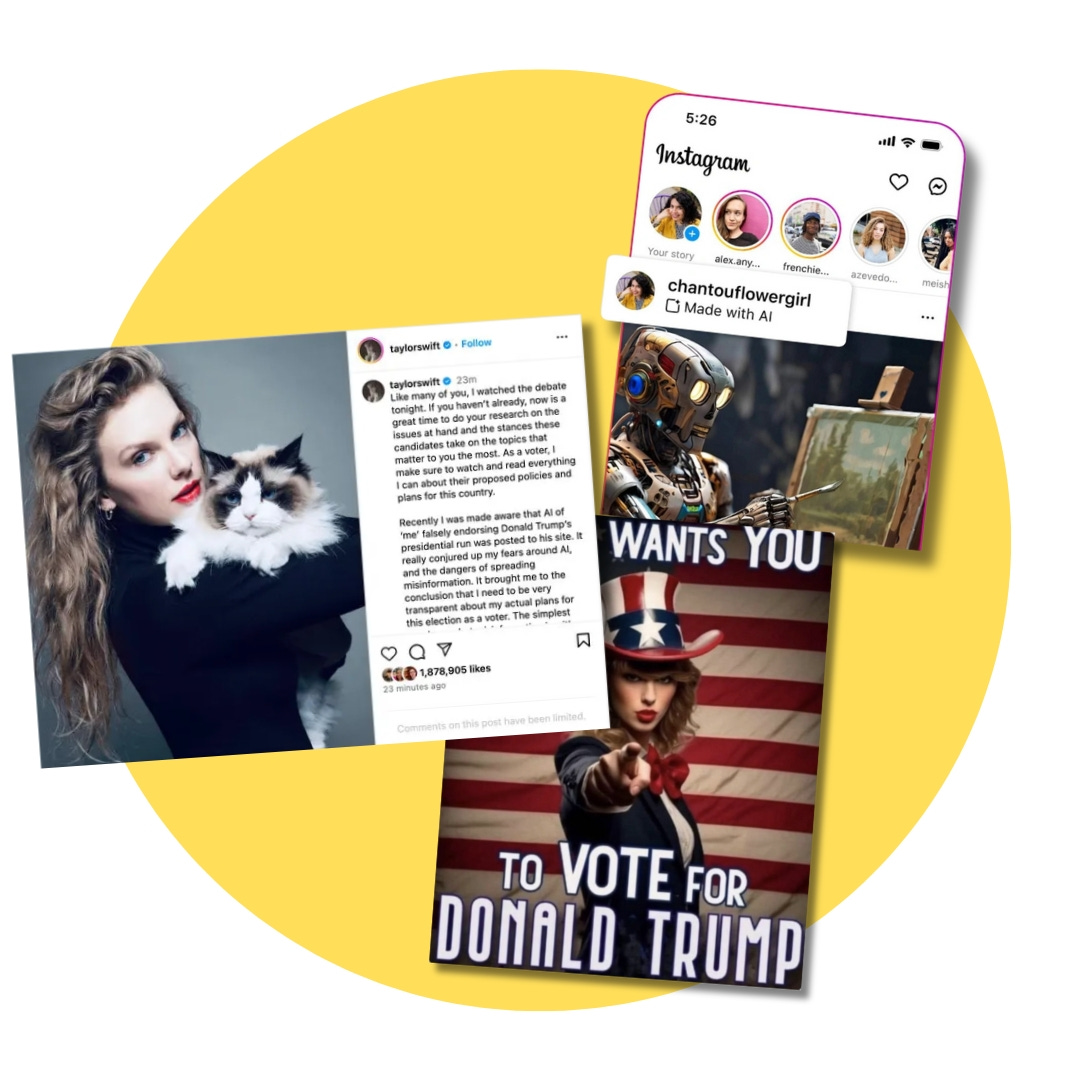

Per esempio, quando Taylor Swift ha pubblicamente sostenuto Kamala Harris, ha citato tra i motivi del suo endorsement i molti deepfake che usano e manipolano la sua immagine a sostegno della campagna di Trump. Un problema che non è solamente americano, ma che anzi si sta diffondendo a tutte le latitudini.

Il torrente dell’informazione online somiglia a un fiume in piena i cui argini non sono mai abbastanza alti.

Per il filosofo Yuval Harari, in questa era di sovraccarico contenutistico, la distorsione delle informazioni causa effetti devastanti che influiscono sulle menti di miliardi di persone.

Oggi più che mai «l'informazione è il collante che tiene insieme i network di esseri umani; quando le persone ricevono informazioni sbagliate è probabile che prendano decisioni sbagliate, a prescindere dalla loro saggezza e dal loro buon senso», ha scritto in Nexus, il suo ultimo libro.

Altre volte, l’IA viene usata senza fini ingannevoli, ma anche perché è un prodotto a buon mercato.

Sempre più spesso per realizzare i propri documentari le case di produzione si affidano all’uso di immagini “storiche” fasulle, ricreate con sistemi automatici, così da risparmiare tempo e denaro.

Anche per questo pochi giorni fa una grande associazione di documentaristi americani ha pubblicato una serie di linee guida per cercare di rendere più trasparente agli occhi degli spettatori l’origine dei video che stanno guardando.

A breve, prima dei titoli di testa di un documentario, potremmo veder comparire dei content warning che ci avviseranno che ciò che stiamo per vedere è stato, almeno parzialmente, realizzato con sistemi generativi intelligenti.

Basterà?

Niente di quello che vediamo online è davvero vero, anche se a prima vista potrebbe sembrarlo. Se la realtà diventa sempre più facile da ritoccare su larga scala, il nostro accesso alla verità diventa sempre più arduo.

Tutto è mediato: da un device che ne comprime la risoluzione, da un’interfaccia che ne determina il formato, da un filtro che ne cambia i connotati, da un algoritmo che ne stabilisce le possibilità di successo.

È difficile anche stabilire cosa significhi ormai il termine stesso, «verità»: gran parte dei contenuti non sono più rappresentazione di qualcosa che è accaduto davvero (perché sono filtrati), né il suo riflesso (perché sono distorti), né la sua espressione (perché sono manipolati).

Le piattaforme - con il loro potere - non stanno facendo granché per risolvere il problema, anzi. I loro modelli di business spingono per la massimizzazione del profitto, non per la trasparenza del processo.

Non a caso, pochi mesi dopo averle introdotte, Meta avrebbe deciso di rendere meno visibili le etichette che indicano quando un contenuto è stato creato o modificato con l’IA.

E poi, a prescindere dalla sua dimensione, un’etichetta non risolve il problema: un deepfake avrà comunque un impatto sulla psicologia della persona cui è difficile porre rimedio — un po’ come il fact-checking a volte non basta a correggere la percezione di una bugia raccontata da un politico, perché arriva tardi.

L’unica soluzione è ridurre, a monte, il contenuto falsificato in circolazione.

Ma chi potrebbe farlo non ne ha particolare interesse. Secondo una ricerca interna di Google che è stata scovata da 404 Media, il fatto che immagini finte possano arrivare a «rompere la realtà» è considerata una funzione e non un bug del proprio “sistema operativo”.

Dall’era della post-verità, insomma, siamo passati all’era della post-realtà.

Quest’epoca non sarà più innocente come il paradiso di Jennifer. Ma possiamo ancora agire affinché non diventi un inferno collettivo.

Alla prossima Ellissi

Valerio

Nimbo, un progetto per sensibilizzare sulla qualità dell'aria

Ciao! Conosci i Nimbo?

I Nimbo sono creature che reagiscono in base alla concentrazione di inquinanti nell'aria, ammalandosi quando questa è inquinata e guarendo quando torna buona e pulita.

Il progetto, realizzato da The Visual Agency, mira a sensibilizzare sul tema della qualità dell'aria, combinando visualizzazione di dati e character design.

Diversi Nimbo sono sparsi nelle principali città italiane ed europee, alimentati dai dati sulla qualità dell’aria forniti dalle API di Google.

Tutte le animazioni data-driven dei Nimbo sono raccolte in questa dashboard dove è possibile confrontarle e visualizzarle nel tempo.

Tramite uno storytelling giornaliero, sui social network (@nimbo_air) puoi monitorare – in modo leggero e pop – lo stato dei singoli Nimbo, e scoprire lo stato e la qualità dell'aria.

Per scoprire come combiniamo tecnologia e design, abbiamo ideato un evento - «Nimbo: progetto di video automazione che racconta la qualità dell’aria» - in programma alla Milano Digital Week l’11 ottobre.

Iscriviti per scoprire tutto quello che facciamo!

Nella mia reading list

🟡 Che poi oh, pure quello del contrasto alla disinformazione è un bel business.

🟡 Anche i video di YouTube vengono usati di nascosto per allenare l’intelligenza artificiale. I creator non sono contenti.

🟡 Per gli editori, l’affiliate marketing è cambiato radicalmente.

🟡 Il New York Times ha deciso di aprire una sua redazione in un paese che aveva lasciato nel 1975. Esatto, proprio lì.

🟡 Un fine settimana con uno spacciatore del dark web.

🟡 La storia che racconto in questa puntata è stata segnalata dalla newsletter nonostantement, che vi consiglio.

🟡 La musica di sottofondo ha bisogno di una propria tassonomia.

🟡 Perché usare il Sole come discarica della Terra non è una grande idea.

🟡 È nata Senza Redazione, una nuova piattaforma che raccoglie informazioni e opportunità per freelance nel mondo della comunicazione e dei media.